On April 17, the highly anticipated "2025 Chengdu Hard Tech Annual Conference" was grandly held. The event attracted over 300 guests from government, enterprises, universities, investment institutions, and other fields, gathering to discuss innovative development paths for the hard tech industry.

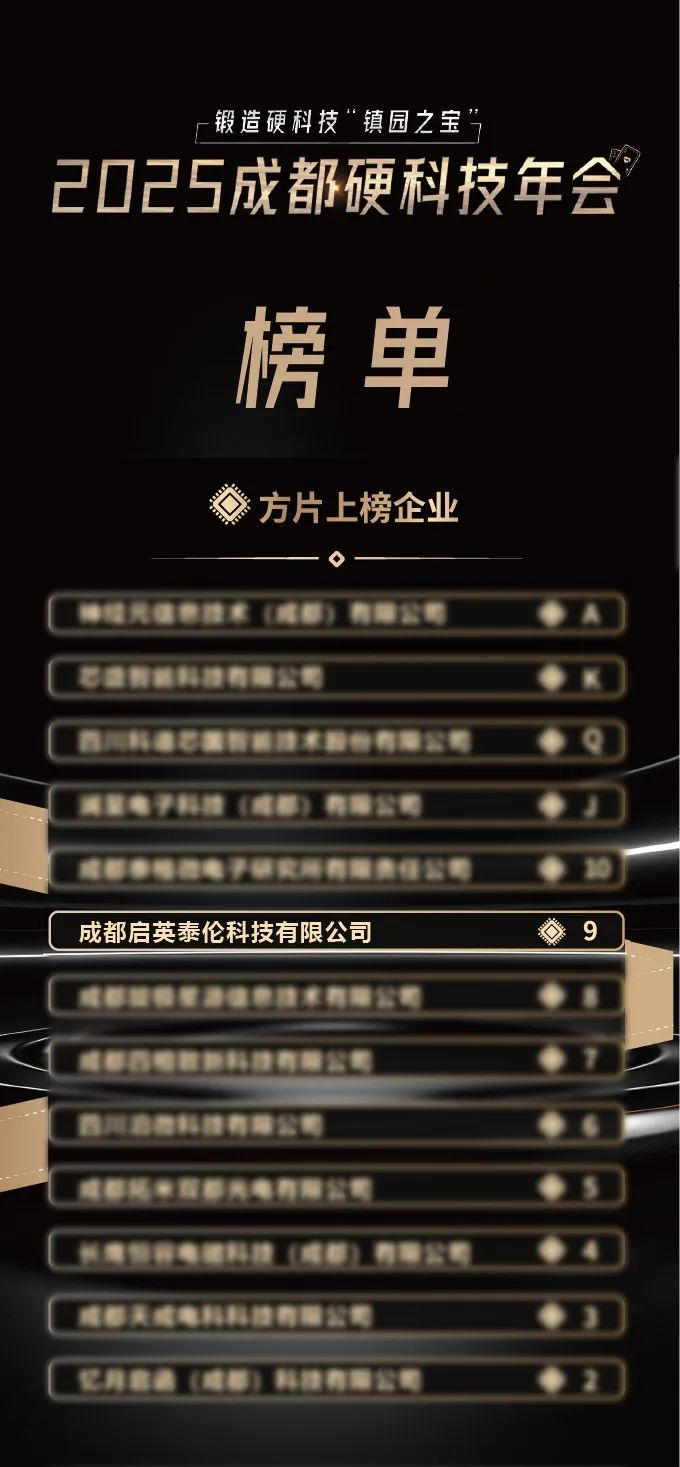

During the annual conference, the "2025 Chengdu Hard Tech Enterprise Playing Cards" list was released. After three rounds of selection—evaluation based on indicator models, online public voting, and expert committee review—Chipintelli, as a leader in the field of artificial intelligence voice chips, successfully made the list.

The "Chengdu Hard Tech Playing Cards" list, a significant barometer of Chengdu's technological innovation, has been curated for six consecutive years. The list focuses on three core dimensions: technological innovation capability, operational capability, and ecosystem capability, rigorously selecting enterprises with core technological breakthroughs and market potential. It is worth mentioning that this is the sixth consecutive year Chipintelli has been selected as a "Diamond" enterprise in the Hard Tech Playing Cards list.

As a key participant in Chengdu's hard tech ecosystem, Chipintelli has dedicated a decade to AI chip R&D. It is one of the earliest enterprises in China to focus on edge-side intelligent voice chips and successfully launched the world's first dedicated edge-side AI voice recognition chip, CI1006. Leveraging its "chip-algorithm integration" capability, Chipintelli has developed an edge-side AI voice algorithm pool covering core functions such as voice wake-up, voice recognition, edge-side semantic understanding, voiceprint recognition, and deep noise reduction. Simultaneously, it has introduced a product matrix of voice chips for applications in smart homes, consumer electronics, security communications, toys, robotics, and more.

With the mission of "Enlightening Life with AI," Chipintelli aims to普及 artificial intelligence to all electronic terminals, making AI voice products affordable and accessible to everyone. Furthermore, it seeks to integrate vision, touch, and other multimodal capabilities on the foundation of voice technology, creating robots with powerful understanding, decision-making, and self-learning abilities to serve all of humanity.

请完善信息,启英泰伦期待与您的合作!